Autor: Jaime Arturo de la Torre.

En sus famosas Lectures on Physics, Feynman describía el proceso de descubrimiento científico de forma muy contundente [1]:

«En general, buscamos una nueva ley siguiendo este proceso: primero formulamos una hipótesis; luego calculamos las consecuencias de dicha hipótesis para ver qué implicaría que la ley que hemos planteado fuera correcta; a continuación, comparamos el resultado del cálculo con la naturaleza, mediante experimentos o la experiencia, lo comparamos directamente con la observación, para ver si funciona. Si no concuerda con los experimentos, es errónea. En esa sencilla afirmación está la clave de la ciencia. No importa lo bonita que sea tu suposición, no importa lo inteligente que seas, quién haya hecho la suposición o cómo se llame: si no concuerda con el experimento, es errónea.»

En esa formulación aparecen dos ingredientes esenciales: teoría y experimento. Aunque es moderna, tiene sus raíces en tiempos de Galileo, con la estructura esencial del método científico: proponer una ley, deducir consecuencias y contrastarlas con la realidad. La física bebe precisamente de esa tensión entre lo que pensamos que ocurre y lo que realmente ocurre.

Pongamos un ejemplo: los experimentos de Robert Brown. En 1827, observó que pequeñas partículas de polen suspendidas en agua se movían de forma errática [2]. No era un movimiento dirigido ni periódico: era irregular, persistente y aparentemente inexplicable. Brown no tenía una teoría. Su descripción era puramente fenomenológica: observaba el fenómeno, pero no podía explicar su origen. De hecho, comprobó que el movimiento persistía también en partículas inertes, descartando cualquier relación con la vida. La explicación no llegó hasta principios del siglo siguiente. En 1905, Einstein propuso que ese movimiento era el resultado de innumerables colisiones con moléculas del fluido [3]. Años después, los experimentos de Perrin demostraron finalmente la interpretación de Einstein [4].

La confirmación experimental de la naturaleza atomística de la materia fue uno de los grandes hitos de la física moderna, con consecuencias profundas. Lo que Brown observaba a simple vista era la manifestación macroscópica de una dinámica microscópica extremadamente compleja. Y aquí aparece un problema fundamental cuando queremos describir la naturaleza. Si queremos explicar completamente el movimiento de esa partícula de polen, en principio deberíamos describir el movimiento de todas las moléculas del fluido que la rodean. La pregunta es inmediata: ¿podemos hacerlo?

A comienzos del siglo XIX, Laplace formuló una respuesta extrema [5]:

«Podemos considerar el estado actual del universo como el efecto de su pasado y la causa de su futuro. Supongamos un intelecto que en un momento dado conociera todas las fuerzas que ponen en movimiento la naturaleza, y todas las posiciones de todos los elementos que la componen. Si ese intelecto fuera también lo suficientemente vasto como para someter esa información a análisis, abarcaría en una sola fórmula los movimientos de los cuerpos más grandes del universo y los del átomo más pequeño; para ese intelecto nada sería incierto y el futuro, al igual que el pasado, podría estar presente ante sus ojos.»

La idea es clara: si conociéramos todas las fuerzas y todas las posiciones, podríamos predecir el futuro de un sistema físico sin incertidumbre. Laplace imaginaba un demonio que disponía de toda la información necesaria para hacer estas predicciones sin limitaciones. En el contexto de la mecánica clásica, por ejemplo, bastaría integrar las ecuaciones de Newton para obtener, en cualquier instante de tiempo, la posición y velocidad de todos los elementos de un sistema físico. Pero el ideal de Laplace contiene una exigencia crucial: conocerlo todo. Y ahí es donde aparece la dificultad real.

En un sistema físico típico, ese todo incluye del orden de $10^{23}$ partículas. Aplicar las leyes de Newton a un conjunto realista de partículas interaccionantes implicaría resolver un sistema gigantesco de ecuaciones diferenciales acopladas. Las leyes son simples. El problema es la escala. El demonio de Laplace no es un imposible porque la física sea incorrecta, sino porque la cantidad de información necesaria es inabordable en la práctica, lo que lleva a preguntarnos cómo avanzar en el conocimiento del mundo que nos rodea.

En los albores de la física, este avance fue posible al estudiar sistemas cuya complejidad estaba controlada: el péndulo simple, el problema de los dos cuerpos, etc. En estos casos, las ecuaciones pueden resolverse de forma exacta. Decimos que son sistemas con pocos grados de libertad y estructuras matemáticas manejables, lo que permite obtener soluciones analíticas. Pero estos sistemas son excepcionales por su simplicidad y distan de ser lo general. En cuanto añadimos más partículas, más interacciones o más escalas temporales, las soluciones analíticas desaparecen. Los sistemas reales (fluidos, materiales, sistemas biológicos) son intrínsecamente complejos. Aquí es donde el ideal de Laplace deja de tener sentido práctico, y el método científico incorpora un ingrediente más a la teoría y el experimento: las simulaciones.

Cuando las ecuaciones no pueden resolverse analíticamente, una de las alternativas más prometedora es hacerlo numéricamente. La simulación numérica transforma las ecuaciones analíticas en algoritmos que evolucionan paso a paso en un ordenador. La simulación permite estudiar sistemas que puede que no tengan solución exacta y que, en muchos casos, tampoco pueden reproducirse fácilmente en el laboratorio. Así, ¿podría un ordenador ser el moderno demonio de Laplace?

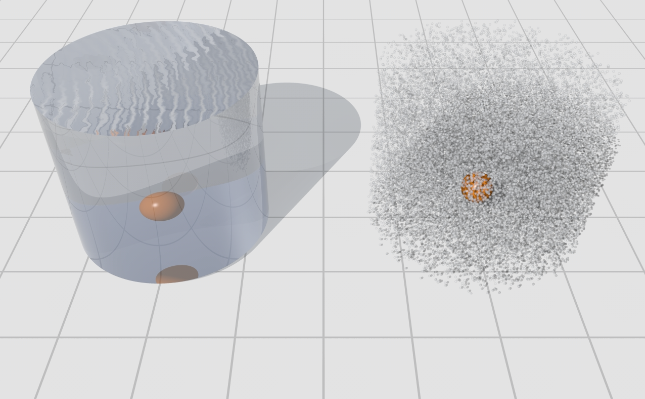

La respuesta es que, lamentablemente, todavía queda un problema por resolver: el problema de las escalas temporales. Consideremos de nuevo el problema de Brown. En una suspensión coloidal como la que estudió, las colisiones moleculares pueden ocurrir en tiempos extremadamente cortos (del orden del picosegundo), mientras que el movimiento apreciable de las partículas suspendidas ocurre en escalas muchos mayores, de milisegundos a segundos. Trabajar simultáneamente con ambas escalas es inviable, incluso con potentes ordenadores. Esto nos lleva a un nuevo enfoque paradigmático. Si lo que queremos es caracterizar el movimiento de los granos de polen, quizás no sea relevante el detalle de las partículas atómicas a su alrededor. El enfoque no es ahora hacer más cálculos, sino cambiar el nivel de detalle. Esto es lo que llamamos la teoría del grano grueso, o, comúnmente en inglés, teoría del coarse-graining.

La teoría del coarse-graining permite, en lugar de describir todos los detalles microscópicos, enfocarse solo en las variables relevantes a la escala que nos interesa [6]. No observamos qué ocurre individualmente con cada partícula, sino que tratamos de estudiar la fenomenología global, macroscópica, del sistema dinámico. Formalmente reducimos el número de grados de libertad, lo que, en muchos casos, transforma las ecuaciones dinámicas deterministas (como las leyes de Newton) en ecuaciones estocásticas y disipativas [7]. Los nuevos términos que aparecen en estas ecuaciones imitan el efecto de las interacciones microscópicas a escalas mucho mayores. Así, de nuevo en el caso de Brown, no seguimos una a una las colisiones microscópicas, sino que incorporamos su efecto colectivo sobre una partícula suspendida. Simplificamos así el problema y conseguimos que, en promedio, estas partículas se desplacen del modo en el que lo hacen en las escalas temporales adecuadas.

La elección de los términos disipativos y de ruido no es, en absoluto, arbitraria. Existe toda una teoría físico-matemática que permite obtener, bajo ciertas condiciones, expresiones cerradas para los elementos que entran en la dinámica macroscópica que estamos estudiando. Gracias a esta teoría, soslayamos el problema de las escalas temporales y reducimos, a la vez, los grados de libertad del sistema, permitiendo obtener soluciones numéricas en tiempos computacionalmente asequibles. La teoría del coarse-graining se ha utilizado con éxito en muchas ramas de la física, y constituye una herramienta fundamental de la mecánica estadística para conectar la descripción microscópica con el comportamiento mesoscópico de la materia.

Hoy, mucho después de Laplace y Feynman, la ciencia contemporánea continúa avanzando, tratando de resolver problemas cada vez más complejos, aprendiendo que, entre leyes y predicciones, es posible no resolver ecuaciones, sino ejecutarlas con un ordenador.

¿Está ya todo resuelto? En absoluto. En próximas entregas veremos cómo, incluso con técnicas como el coarse-graining, seguimos necesitando grandes capacidades de cálculo para afrontar los problemas actuales. Y cómo la supercomputación (el HPC) se ha convertido en un elemento esencial para hacer avanzar la ciencia, en esta ocasión, a hombros de gigantes eléctricos.

Autor: Jaime Arturo de la Torre

Jaime Arturo de la Torre es profesor del Departamento de Física Fundamental de la UNED.

Referencias

[1] Feynman, R. P., Leighton, R. B., & Sands, M. (1963). The Feynman Lectures on Physics, Vol. 1. Addison-Wesley.

[2] Brown, R. (1828). A brief account of microscopical observations made in the months of June, July, and August 1827, on the particles contained in the pollen of plants. Philosophical Magazine, 4, 161–173.

[3] Einstein, A. (1905). On the motion of small particles suspended in liquids at rest required by the molecular-kinetic theory of heat. Annalen der Physik, 17, 549–560.

[4] Perrin, J. (1909). Mouvement brownien et réalité moléculaire. Annales de Chimie et de Physique, 18, 5–114.

[5] Laplace, P. S. (1814). A Philosophical Essay on Probabilities. (Traducción inglesa: Truscott & Emory, John Wiley & Sons).

[6] Gardiner, C. W. (2009). Stochastic Methods: A Handbook for the Natural and Social Sciences (4th ed.). Springer.

[7] Zwanzig, R. (2001). Nonequilibrium Statistical Mechanics. Oxford University Press.

Excelente artículo. Textos como éste, aunque de naturaleza divulgativa, ayudan a situarse en el mapa de los métodos contemporáneos de tratamiento de los resultados de experimentos (y su por qué, la clave de este texto sin duda). La explicación justifica también los diseños experimentales necesarios (o simulaciones). Agradezco las referencias también y mucho.